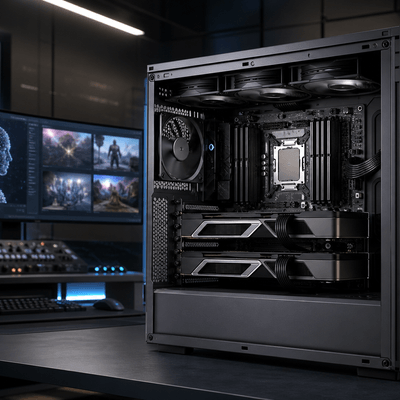

Infraestructura para la

era de la inteligencia.

Desde IA local con Ollama hasta entrenamiento de LLMs a gran escala. Diseñamos clusters y estaciones de trabajo validadas para operar 24/7 bajo cargas AVX-512 y CUDA intensivas.

Workstations para ejecutar modelos 32B-70B sin depender de cloud.

Una máquina para IA local no se diseña como un PC barato por piezas. Validamos VRAM, fuente, placa, refrigeración, espacio físico, ruido y estabilidad antes de facturar.

Si quieres Ollama, LM Studio, ComfyUI, PyTorch o un entorno Linux preparado para trabajo serio, planteamos una arquitectura realista según modelos, presupuesto, garantía y carga 24/7.

Lo que validamos antes de vender

VRAM y modelo objetivo

No es lo mismo inferencia ligera que modelos 32B-70B, visión generativa o multi-GPU.

RTX de consumo vs RTX PRO

Una RTX 5090 de 32GB puede ser una gran base local; una RTX PRO 6000 de 96GB cambia el presupuesto y la validación.

Placa, PCIe y expansión real

Dos ranuras largas no bastan: revisamos x8/x8, separación, caja y aire entre GPUs.

Garantía defendible

Trabajamos con componentes que podamos suministrar, validar y respaldar nosotros.

Precio actualizado

GPUs, memoria y placas cambian por demanda de IA, disponibilidad y mercado global.

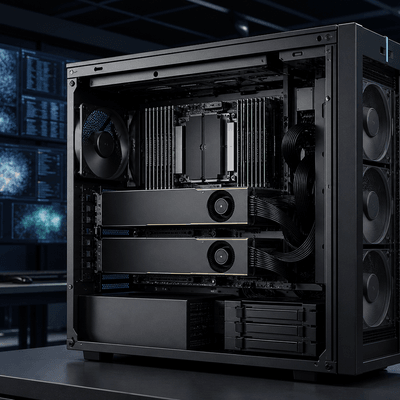

El cuello de botella

es la VRAM.

En el entrenamiento de modelos (LLMs) y la ciencia de datos, la velocidad del procesador es secundaria. El límite real es la memoria de vídeo.

Un PC convencional no puede cargar un modelo Llama-3 70B en memoria. Nuestras arquitecturas Multi-GPU están diseñadas específicamente para sumar VRAM (NVLink / PCIe p2p), permitiendo cargar datasets masivos que harían colapsar a un equipo estándar.

PCIe Lanes

Threadripper PRO ofrece 128 líneas PCIe para alimentar 4 GPUs a velocidad x16 real.

Thermal Velocity

Refrigeración calculada para cargas del 100% durante semanas de entrenamiento.

Entornos validados & optimizados

* Haz clic en tu tecnología para consultar compatibilidad. Entregamos equipos con el stack pre-configurado (Drivers, CUDA Toolkit, Docker NVIDIA Runtime) bajo petición.

Diccionario de hardware IA

Entrenamiento vs Inferencia

El Entrenamiento requiere masiva VRAM y computación FP32/FP16 (GPUs H100/4090). La Inferencia (ejecutar el modelo) es más ligera y puede optimizarse con cuantización (INT8).

VRAM Pooling

Los modelos LLM grandes (70B+) no caben en una sola tarjeta. Usamos NVLink o PCIe paralelo para dividir el modelo entre múltiples GPUs como si fuera una sola memoria gigante.

Tensor Cores

Núcleos especializados en las GPUs NVIDIA que aceleran las operaciones matriciales masivas, el corazón de cualquier red neuronal moderna.

¿Proyecto de investigación o enterprise?

Las necesidades de cómputo varían drásticamente según el modelo y el dataset. No adivines. Habla con nuestros especialistas para dimensionar tu cluster correctamente.

Agendar sesión técnica